últimas postagens

Principais conclusões

- O esquema de clonagem de voz usa IA para replicar vozes de forma autêntica, aproveitando as emoções e a urgência.

- Os golpistas aproveitam os dados das redes sociais para criar cenários verossímeis e explorar laços pessoais.

- Seja cauteloso e aprenda os sinais de alerta dos golpes de clonagem de voz de IA; desligue chamadas e verifique mensagens de socorro.

É tarde da noite. Seus pais recebem uma mensagem de voz sua cheia de pânico, informando que você está com problemas, que sua carteira foi roubada e que você está preso no meio do nada. O dinheiro precisa ser transferido para você imediatamente para que você possa voltar para casa.

A voz na mensagem parece tão real e é inconfundivelmente a do filho deles – só que não é. É um clone de voz de IA, e eles se tornaram alvo de um golpe que é tão inovador quanto assustadoramente eficaz.

Como funciona um golpe de clonagem de voz de IA?

A clonagem de voz pode criar réplicas digitais incrivelmente realistas da voz de uma pessoa. Esta técnica, comumente chamada de áudio deepfake, é criado com ferramentas de clonagem de voz de IA, como ElevenLabs (confira o exemplo de clone de voz de IA abaixo). Combinada com IA generativa e síntese de voz, a voz clonada pode replicar emoções, nuances, entonação e até medo.

E para referência, aqui está como Christian Cawley realmente soa, falando no The Really Useful Podcast.

Para criar um clone de voz de IA, é necessária apenas uma pequena amostra de voz – geralmente apenas um minuto ou menos. Amostras de vozes são frequentemente retiradas de publicações públicas nas redes sociais, tornando os videobloggers e influenciadores particularmente vulneráveis, uma vez que a qualidade do áudio das suas publicações é de alta qualidade e está prontamente disponível.

Depois que os golpistas clonam a amostra de voz, eles usam a conversão de texto em voz ou até mesmo a conversão de voz em tempo real para criar chamadas e mensagens de voz falsas.

Depois de acessar as redes sociais da vítima e reunir seus dados pessoais, o golpista cria um cenário verossímil. Isto pode ser uma hospitalização, prisão, roubo, sequestro – qualquer coisa que crie medo. A voz clonada é então usada para manipular um membro da família fazendo-o acreditar que um ente querido está com sérios problemas.

O realismo da voz e das emoções, combinado com o choque e a urgência do pedido, pode superar o cepticismo, levando a decisões precipitadas de transferência de dinheiro ou de fornecimento de informações sensíveis.

Por que os golpes de clonagem de voz de IA são tão eficazes

Como a maioria dos golpes direcionados a familiares e amigos, o golpe de clonagem de voz de IA é eficaz porque explora laços pessoais. O pânico de receber um pedido de socorro de um ente querido pode rapidamente atrapalhar o julgamento, resultando em decisões precipitadas. É a mesma tática usada em golpes de troca de dinheiro, mas o efeito é agravado ao ouvir a voz de alguém próximo a você.

Os familiares daqueles com grande presença nas redes sociais ou daqueles que viajam estão particularmente em risco porque as suas situações fornecem um contexto plausível para a narrativa fabricada do golpista. Os golpistas muitas vezes coletam e usam os dados privados de seus alvos de suas contas públicas de mídia social com antecedência, tornando as histórias ainda mais convincentes.

Principais sinais de um golpe de clone de voz de IA

Apesar de sua sofisticação, os golpes de clonagem de voz de IA podem se revelar por meio de sinais de alerta específicos:

- Urgência: O golpista irá convencê-lo de que algo terrível acontecerá se uma ação não for tomada imediatamente.

- Fatos: Os golpistas nem sempre conhecem a história completa por trás do seu relacionamento com o alvo, portanto, preste atenção às inconsistências.

- Solicitações incomuns: Solicitações de transferência de dinheiro para contas bancárias no exterior ou pagamento para uma carteira de criptomoeda são táticas comuns.

É difícil considerar esses fatores quando se depara com um cenário terrível, mas pode impedir que você seja enganado.

O que fazer se você suspeitar de um golpe de clone de voz de IA

Se você receber uma ligação ou mensagem de voz de entes queridos em perigo, mantenha a calma. Os golpistas contam com você para entrar em pânico e ficar emocionado, pois isso aumenta sua vulnerabilidade às táticas deles.

Se você receber uma chamada telefônica

Se você suspeitar, mesmo que por um segundo, que uma chamada pode ser um golpe de clonagem de voz, desligue imediatamente a chamada. Não compartilhe nenhuma informação e não se envolva com golpistas. Em vez disso, ligue de volta para o seu ente querido em um número conhecido para confirmar a autenticidade da chamada de socorro.

Conversar mais com os golpistas pode correr o risco de ter sua voz gravada e clonada também.

Se você receber uma mensagem de voz

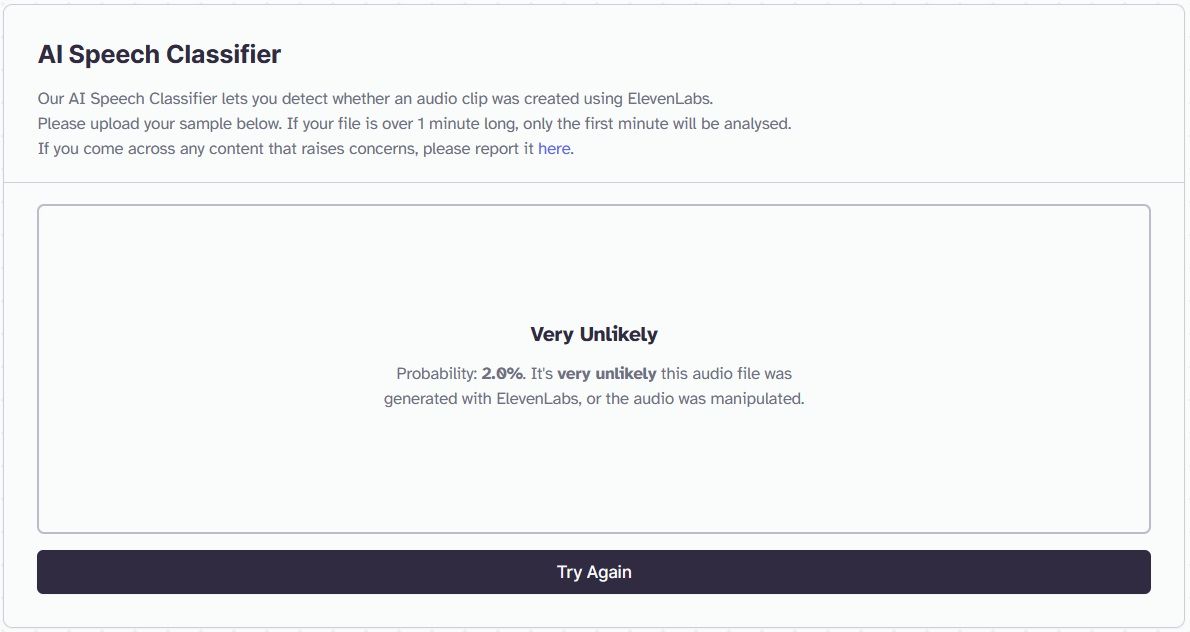

Se os golpistas deixaram uma mensagem de voz, salve o áudio em seu telefone ou laptop imediatamente. Esta amostra de áudio pode ser usada em uma ferramenta classificadora de fala de IA para determinar se é uma voz humana. Esses classificadores de fala de IA funcionam como detectores de escrita de IA. Basta inserir o arquivo de áudio e o classificador irá marcá-lo como humano ou gerado por IA.

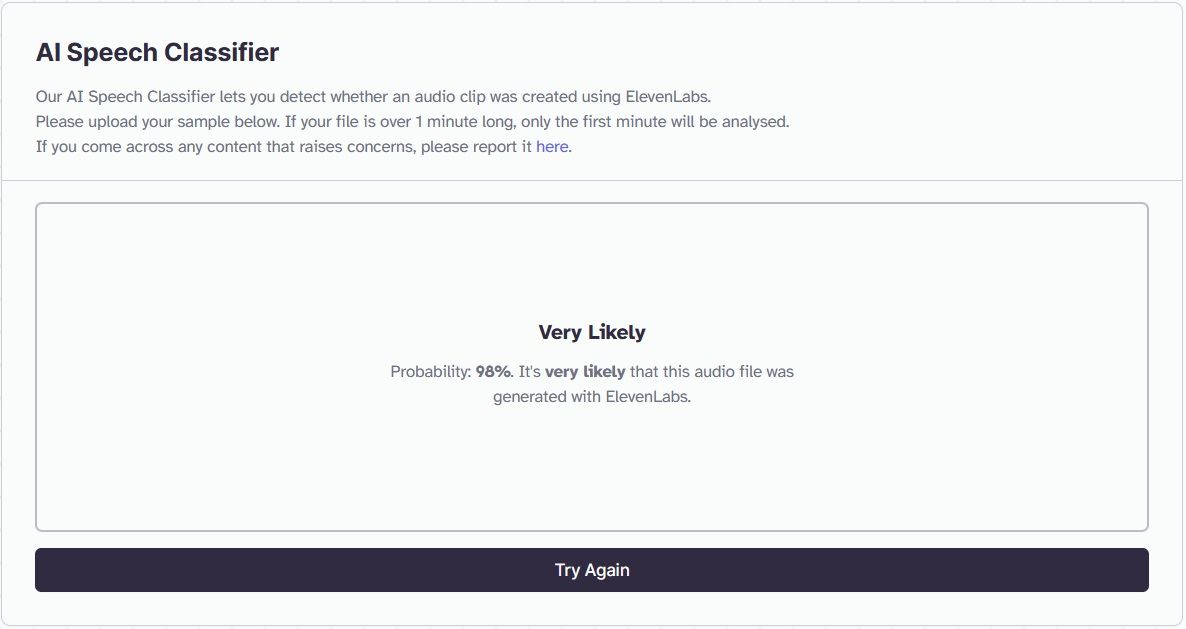

Uma ótima ferramenta para realizar essa verificação é o classificador de fala ElevenLabs. ElevenLabs alimenta a maioria das plataformas de clonagem de IA, por isso é uma ferramenta ideal para determinar se uma voz foi clonada. Veja como você pode usá-lo para determinar uma voz clonada por IA:

No exemplo abaixo, uma mensagem angustiante foi gravada por um humano e carregada no classificador. Você pode ver que ele foi marcado como tendo 2% de probabilidade de ser manipulado.

No próximo exemplo, a mesma mensagem angustiante foi produzida com uma ferramenta de clonagem de voz de IA. Ao ouvido humano, as vozes são indistinguíveis. A ferramenta, no entanto, marcou-a como tendo 98% de probabilidade de ser gerada por IA.

Embora você não possa confiar 100% neste classificador, ele pode confirmar suas suspeitas de que uma voz clonada está em uso. Você também deve entrar em contato com seu ente querido por um número conhecido para confirmar.

A prevenção é a melhor defesa contra golpes de clonagem de voz de IA

Às vezes, a melhor defesa contra um golpe de alta tecnologia é uma solução de baixa tecnologia.

Estabeleça uma senha offline conhecida apenas por seus familiares e amigos. No caso de uma chamada frenética, usar esta senha pode ser uma maneira infalível de confirmar a identidade de quem está ligando.

Por fim, manter suas informações privadas fora das redes sociais é um grande passo para garantir que os golpistas não consigam coletar informações suficientes para construir uma narrativa. Lembre-se: se você não quer que todos saibam, é melhor não compartilhá-lo nas redes sociais.