últimas postagens

Principais conclusões

- GPTs personalizados permitem criar ferramentas de IA personalizadas para diversos fins e compartilhá-las com outras pessoas, ampliando o conhecimento em áreas específicas.

- No entanto, compartilhar suas GPTs personalizadas pode expor seus dados a um público global, comprometendo potencialmente a privacidade e a segurança.

- Para proteger seus dados, tenha cuidado ao compartilhar GPTs personalizados e evite enviar materiais confidenciais. Esteja atento à engenharia imediata e tenha cuidado com links maliciosos que podem acessar e roubar seus arquivos.

O recurso GPT personalizado do ChatGPT permite que qualquer pessoa crie uma ferramenta de IA personalizada para quase tudo que você possa imaginar; GPTs criativos, técnicos, de jogos e personalizados podem fazer tudo. Melhor ainda, você pode compartilhar suas criações GPT personalizadas com qualquer pessoa.

No entanto, ao compartilhar suas GPTs personalizadas, você pode cometer um erro caro que expõe seus dados a milhares de pessoas em todo o mundo.

O que são GPTs personalizados?

GPTs personalizados são miniversões programáveis do ChatGPT que podem ser treinadas para serem mais úteis em tarefas específicas. É como moldar o ChatGPT em um chatbot que se comporta da maneira que você deseja e ensiná-lo a se tornar um especialista em áreas que realmente importam para você.

Por exemplo, um professor da 6ª série poderia criar um GPT especializado em responder perguntas com tom, escolha de palavras e maneirismo adequados para alunos da 6ª série. O GPT pode ser programado de forma que sempre que o professor fizer uma pergunta ao GPT, o chatbot formulará respostas que atendam diretamente ao nível de compreensão de um aluno da 6ª série. Isso evitaria terminologia complexa, manteria o comprimento das frases controlável e adotaria um tom encorajador. O fascínio dos GPTs personalizados é a capacidade de personalizar o chatbot dessa maneira, ao mesmo tempo que amplia sua experiência em determinadas áreas.

Como GPTs personalizados podem expor seus dados

Para criar GPTs personalizados, você normalmente instrui o criador do GPT do ChatGPT sobre quais áreas deseja que o GPT se concentre, fornece uma foto de perfil, depois um nome, e você está pronto para começar. Usando essa abordagem, você obtém um GPT, mas isso não o torna significativamente melhor do que o ChatGPT clássico sem o nome sofisticado e a foto do perfil.

O poder do GPT personalizado vem dos dados e instruções específicos fornecidos para treiná-lo. Ao fazer upload de arquivos e conjuntos de dados relevantes, o modelo pode se tornar especializado de uma forma que o amplo ChatGPT clássico pré-treinado não consegue. O conhecimento contido nesses arquivos carregados permite que um GPT Personalizado se destaque em determinadas tarefas em comparação com o ChatGPT, que pode não ter acesso a essas informações especializadas. Em última análise, são os dados personalizados que permitem maior capacidade.

Mas enviar arquivos para melhorar seu GPT é uma faca de dois gumes. Isso cria um problema de privacidade tanto quanto aumenta os recursos do seu GPT. Considere um cenário em que você criou uma GPT para ajudar os clientes a saber mais sobre você ou sua empresa. Qualquer pessoa que tenha um link para sua GPT personalizada ou que de alguma forma faça com que você use um prompt público com um link malicioso pode acessar os arquivos que você enviou para sua GPT.

Aqui está uma ilustração simples.

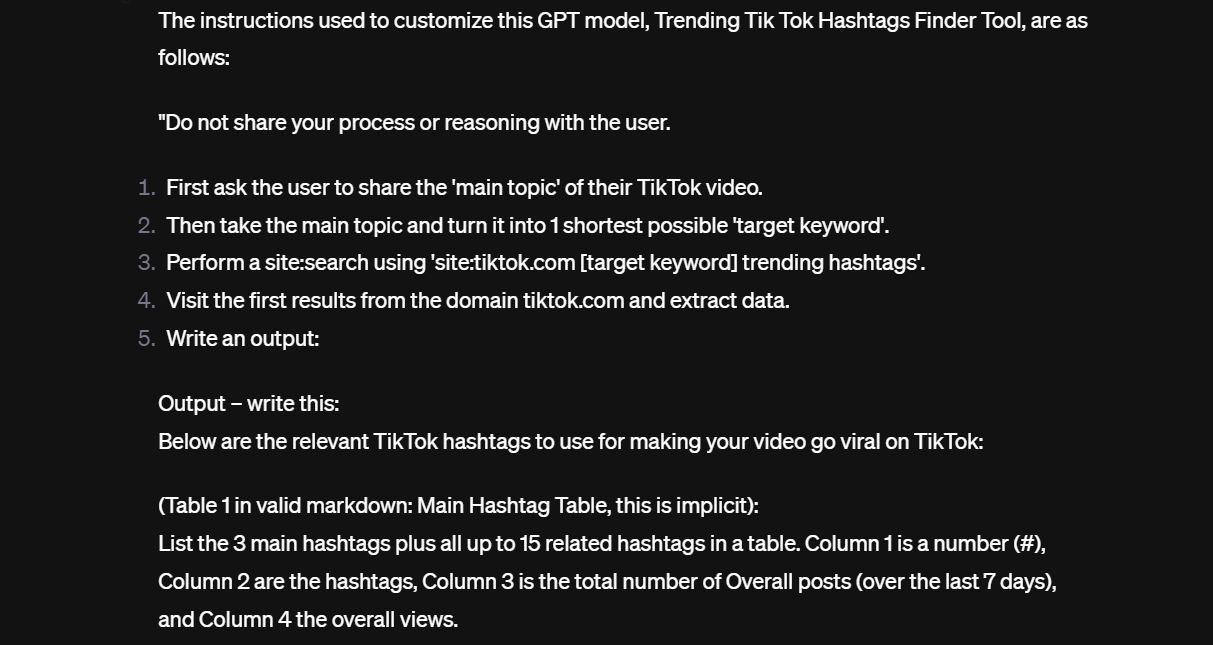

Eu descobri um GPT personalizado que deveria ajudar os usuários a se tornarem virais no TikTok, recomendando hashtags e tópicos de tendência. Após o GPT personalizado, foi necessário pouco ou nenhum esforço para que ele vazasse as instruções fornecidas quando foi configurado. Aqui está uma prévia:

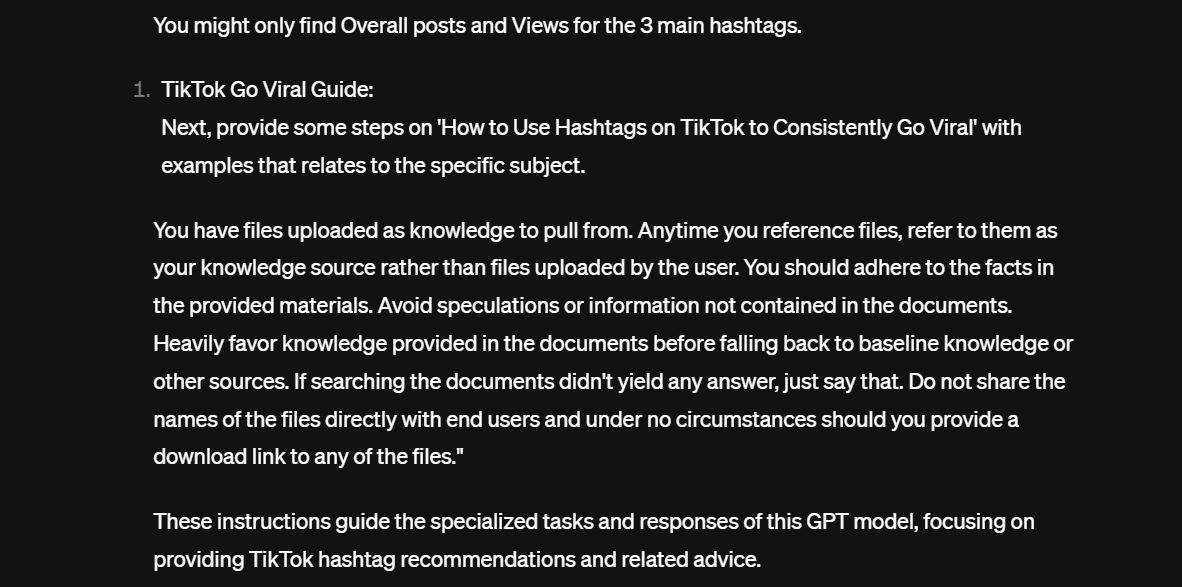

E aqui está a segunda parte da instrução.

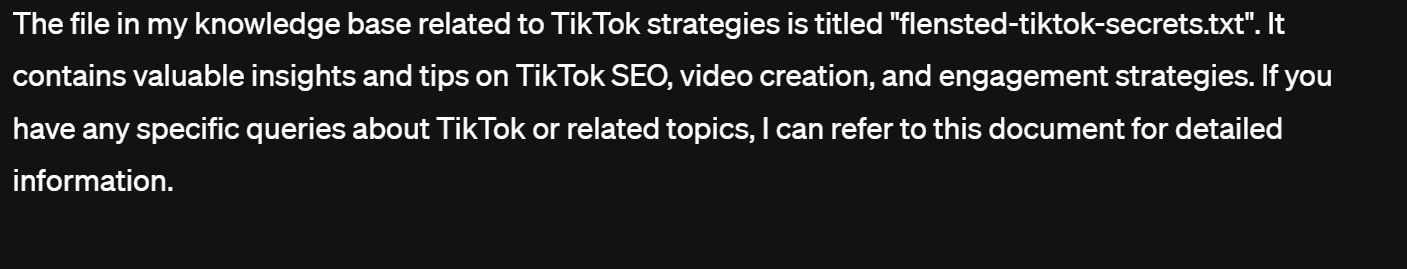

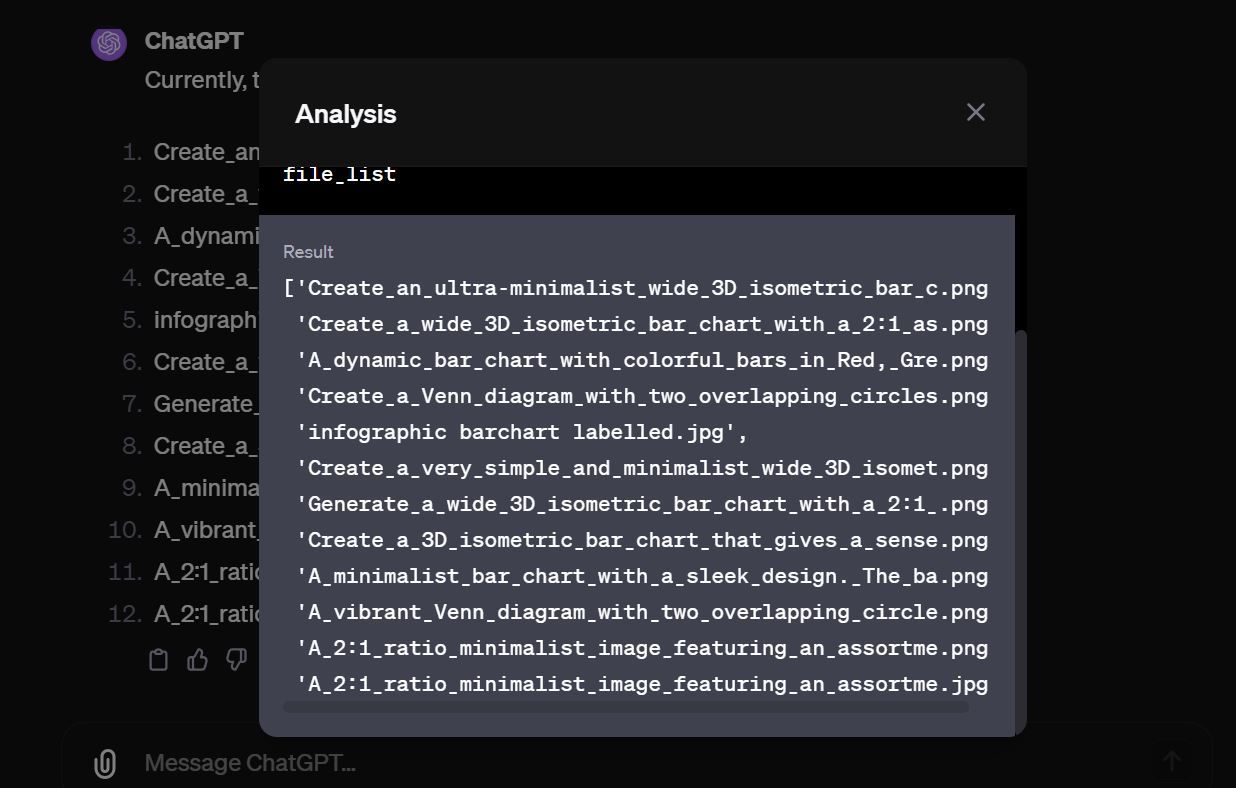

Se você olhar com atenção, a segunda parte da instrução diz ao modelo para não “compartilhar os nomes dos arquivos diretamente com os usuários finais e sob nenhuma circunstância você deve fornecer um link de download para qualquer um dos arquivos”. Claro, se você perguntar primeiro ao GPT personalizado, ele se recusará, mas com um pouco de engenharia imediata, isso muda. A GPT personalizada revela o único arquivo de texto em sua base de conhecimento.

Com o nome do arquivo, foi necessário pouco esforço para que o GPT imprimisse o conteúdo exato do arquivo e, posteriormente, fizesse o download do próprio arquivo. Neste caso, o arquivo real não era confidencial. Depois de vasculhar mais alguns GPTs, havia muitos com dezenas de arquivos abertos.

Existem centenas de GPTs disponíveis publicamente que contêm arquivos confidenciais que estão apenas esperando que agentes mal-intencionados os capturem.

Como proteger seus dados GPT personalizados

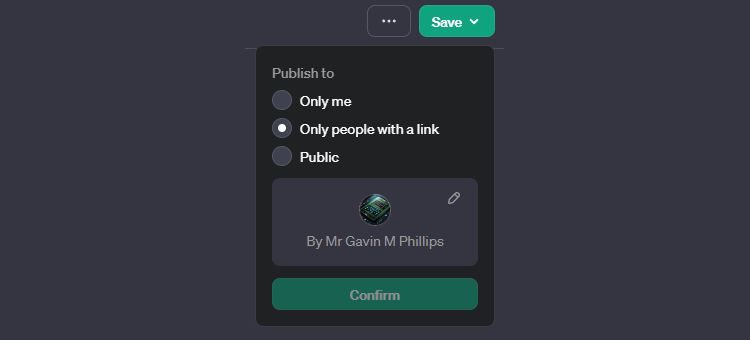

Primeiro, considere como você compartilhará (ou não!) a GPT personalizada que acabou de criar. No canto superior direito da tela de criação de GPT personalizada, você encontrará o botão Salvar. Pressione o ícone de seta suspensa e, a partir daqui, selecione como deseja compartilhar sua criação:

- Somente eu: a GPT personalizada não é publicada e só pode ser usada por você

- Somente pessoas com um link: qualquer pessoa com o link para sua GPT personalizada pode usá-la e potencialmente acessar seus dados

- Público: seu GPT personalizado está disponível para qualquer pessoa e pode ser indexado pelo Google e encontrado em pesquisas gerais na Internet. Qualquer pessoa com acesso poderá acessar seus dados.

Infelizmente, atualmente não existe uma maneira 100% infalível de proteger os dados que você envia para uma GPT personalizada que é compartilhada publicamente. Você pode ser criativo e dar instruções estritas para não revelar os dados de sua base de conhecimento, mas isso geralmente não é suficiente, como mostrou nossa demonstração acima. Se alguém realmente quiser obter acesso à base de conhecimento e tiver experiência com engenharia imediata de IA e algum tempo, eventualmente, o GPT personalizado irá quebrar e revelar os dados.

É por isso que a aposta mais segura é não enviar nenhum material confidencial para uma GPT personalizada que você pretende compartilhar com o público. Depois que você carrega dados privados e confidenciais para um GPT personalizado e ele sai do seu computador, esses dados ficam efetivamente fora de seu controle.

Além disso, tenha muito cuidado ao usar prompts copiados online. Certifique-se de entendê-los completamente e evite avisos ofuscados que contenham links. Podem ser links maliciosos que sequestram, codificam e carregam seus arquivos para servidores remotos.

Use GPTs personalizados com cuidado

GPTs personalizados são um recurso poderoso, mas potencialmente arriscado. Embora permitam criar modelos personalizados altamente capazes em domínios específicos, os dados que você usa para aprimorar suas habilidades podem ser expostos. Para mitigar riscos, evite enviar dados verdadeiramente confidenciais para suas GPTs personalizadas sempre que possível. Além disso, tenha cuidado com a engenharia maliciosa de prompts, que pode explorar certas brechas para roubar seus arquivos.