Principais Observações

- Empresas de grande porte como Open AI, Google, Microsoft e Meta estão direcionando seus investimentos para os Modelos de Linguagem Pequenos (MSLs).

- Os MSLs estão se consolidando no mercado, sendo considerados o futuro promissor da Inteligência Artificial (IA).

- Exemplos notáveis de MSLs incluem o Google Nano, o Phi-3 da Microsoft e o GPT-4o mini da Open AI.

Com o lançamento do ChatGPT pela Open AI, os Modelos de Linguagem de Grande Porte (MLPs) ganharam destaque. Diversas outras empresas também lançaram seus MLPs, mas agora, o foco se volta para os Modelos de Linguagem Pequenos (MSLs). Nesta nova fase digital, os MSLs emergem como protagonistas, levantando a questão: o que são eles e como se diferenciam dos MLPs?

Os MSLs estão em ascensão, mas qual é sua definição e como eles se comparam aos MLPs?

Entendendo o Modelo de Linguagem Pequeno

Um Modelo de Linguagem Pequeno (MSL) é uma modalidade de inteligência artificial caracterizada por um número reduzido de parâmetros (um valor no modelo obtido durante o treinamento). Assim como suas contrapartes maiores, os MSLs são capazes de gerar textos e executar outras tarefas. No entanto, eles se distinguem por utilizar conjuntos de dados menores para treinamento, possuir menos parâmetros e demandar menos poder computacional para treinamento e operação.

Os MSLs se concentram em funcionalidades essenciais, e sua dimensão compacta permite a implantação em diversos dispositivos, inclusive aqueles sem hardware de ponta, como dispositivos móveis. O Nano do Google, por exemplo, é um MSL concebido para operar em dispositivos móveis. Devido ao seu tamanho reduzido, o Nano pode funcionar localmente, com ou sem conexão à internet, de acordo com a empresa.

Além do Nano, existem vários outros MSLs desenvolvidos por empresas líderes e emergentes na área de IA. Alguns exemplos populares incluem o Phi-3 da Microsoft, o GPT-4o mini da OpenAI, o Claude 3 Haiku da Anthropic, o Llama 3 da Meta e o Mixtral 8x7B da Mistral AI.

Outras alternativas também estão disponíveis, as quais podem ser consideradas MLPs, mas são MSLs. Isso é relevante, pois muitas empresas adotam a estratégia multi-modelo, lançando mais de um modelo de linguagem em seu portfólio, com opções tanto de MLPs quanto de MSLs. Um exemplo é o GPT-4, que oferece diferentes modelos, incluindo o GPT-4, GPT-4o (Omni) e GPT-4o mini.

Confronto: Modelos de Linguagem Pequenos e Modelos de Linguagem Grandes

Ao abordarmos os MSLs, não podemos ignorar seus equivalentes maiores: os MLPs. A principal distinção entre um MSL e um MLP reside no tamanho do modelo, que é avaliado em termos de parâmetros.

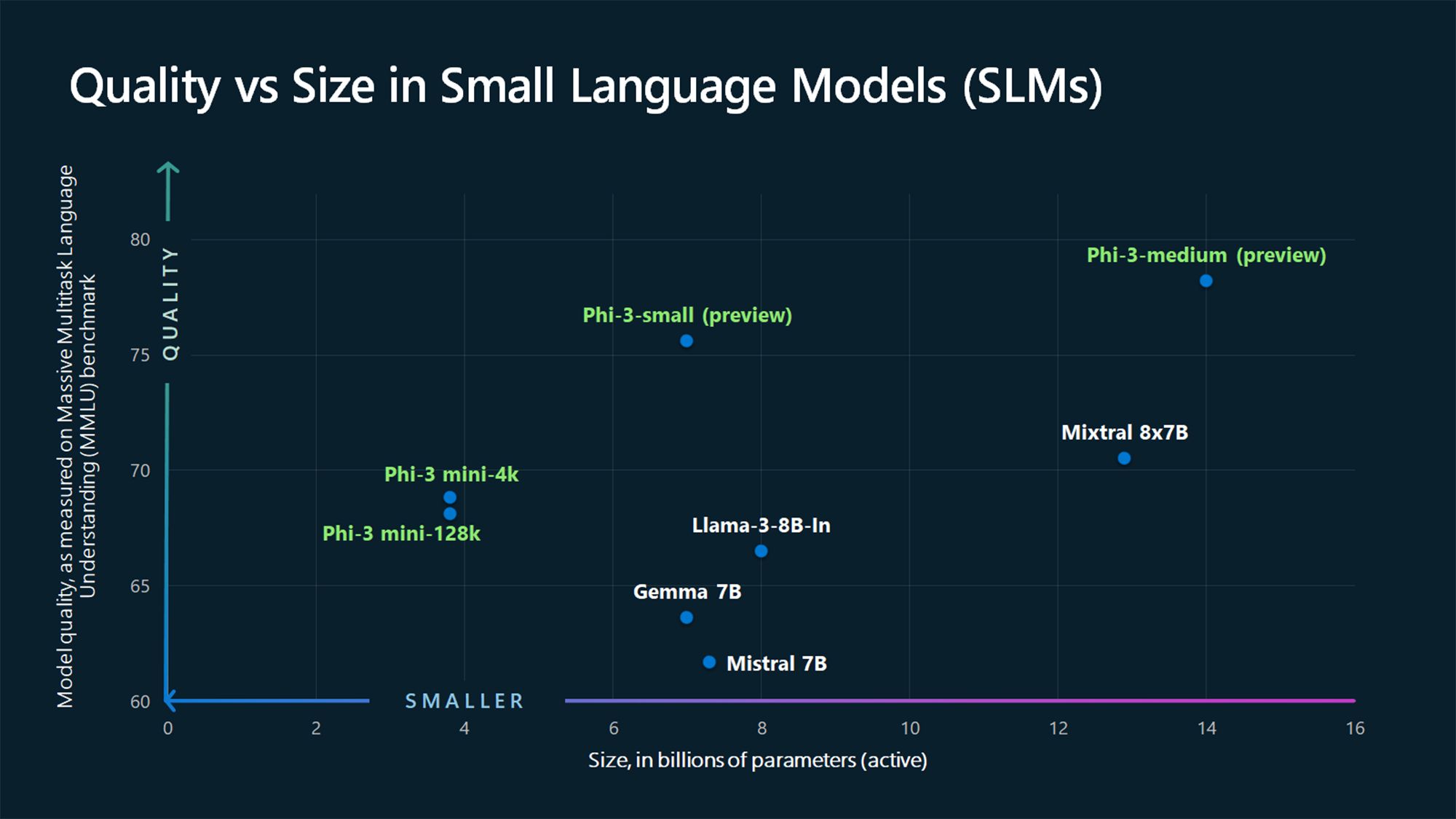

Atualmente, não há um consenso na indústria de IA sobre o limite máximo de parâmetros para que um modelo seja considerado um MSL, nem o mínimo para ser classificado como um MLP. No entanto, os MSLs geralmente possuem de milhões a alguns bilhões de parâmetros, enquanto os MLPs podem chegar a trilhões.

A título de ilustração, o GPT-3, lançado em 2020, possui 175 bilhões de parâmetros (e há rumores de que o modelo GPT-4 tenha cerca de 1,76 trilhão), enquanto os MSLs Phi-3-mini, Phi-3-small e Phi-3-medium da Microsoft, lançados em 2024, possuem, respectivamente, 3,8, 7 e 14 bilhões de parâmetros.

Outro fator de diferenciação entre MSLs e MLPs é a quantidade de dados usada para o treinamento. Os MSLs são treinados com conjuntos de dados menores, enquanto os MLPs utilizam vastos volumes de dados. Essa diferença também impacta a capacidade do modelo de realizar tarefas complexas.

Devido à grande quantidade de dados utilizada no treinamento, os MLPs são mais adequados para resolver tarefas complexas que exigem raciocínio avançado, enquanto os MSLs são mais apropriados para tarefas mais simples. Ao contrário dos MLPs, os MSLs utilizam menos dados de treinamento, mas a qualidade desses dados precisa ser superior para que alcancem muitas das capacidades encontradas nos MLPs, tudo isso em um pacote compacto.

A Razão do Futuro: Por Que os Modelos de Linguagem Pequenos São o Caminho

Para a maioria das aplicações, os MSLs estão em melhor posição para se tornarem os modelos predominantes usados por empresas e consumidores para executar uma ampla gama de tarefas. Os MLPs, sem dúvida, têm suas vantagens e são mais adequados para certos casos, como a resolução de tarefas complexas. No entanto, os MSLs representam o futuro para a maioria dos casos de uso pelas razões que serão apresentadas a seguir.

1. Redução de Custos com Treinamento e Manutenção

Timofeev Vladimir/Shutterstock

Timofeev Vladimir/Shutterstock

Os MSLs necessitam de menos dados para treinamento do que os MLPs, o que os torna uma opção mais viável para indivíduos e pequenas a médias empresas com dados de treinamento, recursos financeiros ou ambos limitados. Os MLPs exigem vastas quantidades de dados e, consequentemente, necessitam de recursos computacionais consideráveis para serem treinados e operados.

Para ilustrar, o CEO da OpenAI, Sam Altman, confirmou que o treinamento do GPT-4 custou mais de 100 milhões de dólares, conforme mencionado em um evento no MIT (segundo a Wired). Outro exemplo é o MLP OPT-175B da Meta. A Meta informa que foi treinado usando 992 GPUs NVIDIA A100 de 80GB, que custam aproximadamente 10.000 dólares por unidade, segundo a CNBC. Isso eleva o custo para aproximadamente 9 milhões de dólares, sem incluir outros gastos, como energia e salários.

Com tais cifras, torna-se inviável para pequenas e médias empresas treinar um MLP. Em contraste, os MSLs apresentam uma barreira de entrada mais baixa em termos de recursos e custos de operação, o que os tornará mais populares entre as empresas.

2. Desempenho Superior

GBJSTOCK / Shutterstock

GBJSTOCK / Shutterstock

O desempenho é outra área em que os MSLs se destacam em relação aos MLPs, devido ao seu tamanho compacto. Os MSLs têm menor latência e são mais adequados para situações que exigem respostas rápidas, como em aplicações em tempo real. Por exemplo, respostas mais rápidas são desejáveis em sistemas de resposta por voz, como assistentes digitais.

A execução local (detalhada a seguir) também significa que sua solicitação não precisa trafegar até os servidores online e retornar para responder à sua consulta, resultando em respostas mais ágeis.

3. Precisão Aprimorada

ZinetroN / Shutterstock

ZinetroN / Shutterstock

Quando se trata de IA generativa, uma regra permanece constante: o que entra, é o que sai. Os MLPs atuais foram treinados usando grandes conjuntos de dados brutos da internet, portanto, podem não ser precisos em todas as situações. Esse é um dos problemas com o ChatGPT e modelos semelhantes, e é por isso que não devemos confiar cegamente em tudo o que um chatbot de IA diz. Por outro lado, os MSLs são treinados com dados de maior qualidade do que os MLPs, o que resulta em maior precisão.

Os MSLs também podem ser ajustados com treinamento focado em tarefas ou domínios específicos, o que leva a uma maior precisão nessas áreas em comparação com modelos maiores e mais generalizados.

4. Execução no Dispositivo

Pete Hansen/Shutterstock

Pete Hansen/Shutterstock

Os MSLs exigem menos poder computacional do que os MLPs e, portanto, são ideais para casos de computação de borda. Eles podem ser implantados em dispositivos de borda, como smartphones e veículos autônomos, que não possuem grande poder computacional ou recursos. O modelo Nano do Google pode funcionar localmente, permitindo que seja usado mesmo sem uma conexão com a internet.

Essa capacidade representa uma situação vantajosa tanto para empresas quanto para consumidores. Primeiro, é um ganho para a privacidade, pois os dados do usuário são processados localmente, em vez de serem enviados para a nuvem, o que é relevante à medida que mais IA é integrada aos nossos smartphones, que contêm praticamente todos os detalhes sobre nós. Também é vantajoso para as empresas, pois elas não precisam implementar e operar grandes servidores para lidar com as tarefas de IA.

Os MSLs estão ganhando força, com grandes empresas do setor, como Open AI, Google, Microsoft, Anthropic e Meta, lançando tais modelos. Esses modelos são mais adequados para tarefas mais simples, que são aquelas para as quais a maioria de nós usa MLPs; portanto, eles representam o futuro.

Mas os MLPs não estão desaparecendo. Em vez disso, eles serão usados para aplicações avançadas que combinam informações de diferentes domínios para criar algo novo, como em pesquisas médicas.

Em resumo: Os Modelos de Linguagem Pequena (MSLs) estão se destacando como a nova tendência em IA, superando os Modelos de Linguagem Grande (MLPs) em termos de eficiência, desempenho e aplicabilidade em diversas situações. Com investimentos de gigantes como Open AI, Google e Microsoft, os MSLs prometem ser o futuro da inteligência artificial, oferecendo uma ampla gama de aplicações a um custo mais acessível.