O processamento de big data é um dos procedimentos mais complexos que as organizações enfrentam. O processo se torna mais complicado quando você tem um grande volume de dados em tempo real.

Neste post, vamos descobrir o que é o processamento de big data, como ele é feito e explorar o Apache Kafka e o Spark – as duas ferramentas de processamento de dados mais famosas!

últimas postagens

O que é Processamento de Dados? Como isso é feito?

O processamento de dados é definido como qualquer operação ou conjunto de operações, realizadas ou não por meio de um processo automatizado. Pode ser pensado como a coleta, ordenação e organização de informações de acordo com uma disposição lógica e apropriada para interpretação.

Quando um usuário acessa um banco de dados e obtém resultados para sua pesquisa, é o processamento de dados que está obtendo os resultados de que precisam. A informação extraída como resultado da pesquisa é o resultado do processamento de dados. É por isso que a tecnologia da informação tem o foco de sua existência centrado no processamento de dados.

O processamento de dados tradicional foi realizado usando um software simples. No entanto, com o surgimento do Big Data, as coisas mudaram. Big Data refere-se a informações cujo volume pode ser superior a cem terabytes e petabytes.

Além disso, essas informações são atualizadas regularmente. Os exemplos incluem dados provenientes de contact centers, mídia social, dados de negociação de bolsa de valores, etc. Esses dados às vezes também são chamados de fluxo de dados – um fluxo de dados constante e descontrolado. Sua principal característica é que os dados não possuem limites definidos, por isso é impossível dizer quando o fluxo começa ou termina.

Os dados são processados à medida que chegam ao destino. Alguns autores chamam de processamento em tempo real ou online. Uma abordagem diferente é o processamento em bloco, em lote ou offline, no qual os blocos de dados são processados em janelas de tempo de horas ou dias. Muitas vezes, o lote é um processo que é executado à noite, consolidando os dados daquele dia. Há casos de janelas de tempo de uma semana ou até de um mês gerando relatórios desatualizados.

Dado que as melhores plataformas de processamento de Big Data via streaming são open source como Kafka e Spark, estas plataformas permitem a utilização de outras diferentes e complementares. Isso significa que sendo open source, eles evoluem mais rápido e usam mais ferramentas. Desta forma, os fluxos de dados são recebidos de outros locais a uma taxa variável e sem interrupções.

Agora, vamos olhar para duas das ferramentas de processamento de dados mais conhecidas e compará-las:

Apache Kafka

Apache Kafka é um sistema de mensagens que cria aplicativos de streaming com um fluxo de dados contínuo. Originalmente criado pelo LinkedIn, o Kafka é baseado em logs; um log é uma forma básica de armazenamento porque cada nova informação é adicionada ao final do arquivo.

Kafka é uma das melhores soluções para big data porque sua principal característica é seu alto rendimento. Com o Apache Kafka, é ainda possível transformar o processamento em lote em tempo real,

Apache Kafka é um sistema de mensagens de publicação-assinatura no qual um aplicativo publica e um aplicativo que assina recebe mensagens. O tempo entre a publicação e o recebimento da mensagem pode ser de milissegundos, portanto, uma solução Kafka tem baixa latência.

Trabalho de Kafka

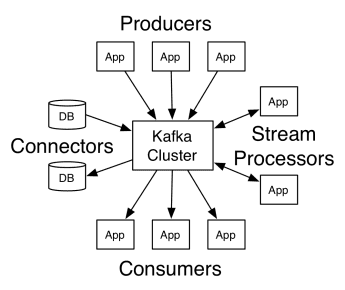

A arquitetura do Apache Kafka compreende produtores, consumidores e o próprio cluster. O produtor é qualquer aplicativo que publica mensagens no cluster. O consumidor é qualquer aplicativo que receba mensagens do Kafka. O cluster Kafka é um conjunto de nós que funciona como uma única instância do serviço de mensagens.

Trabalho de Kafka

Trabalho de Kafka

Um cluster Kafka é composto por vários corretores. Um broker é um servidor Kafka que recebe mensagens de produtores e as grava em disco. Cada broker gerencia uma lista de tópicos e cada tópico é dividido em várias partições.

Após receber as mensagens, o broker as envia aos consumidores cadastrados para cada tópico.

As configurações do Apache Kafka são gerenciadas pelo Apache Zookeeper, que armazena metadados do cluster, como localização da partição, lista de nomes, lista de tópicos e nós disponíveis. Assim, o Zookeeper mantém a sincronização entre os diferentes elementos do cluster.

O Zookeeper é importante porque o Kafka é um sistema distribuído; ou seja, a escrita e a leitura são feitas por vários clientes simultaneamente. Quando há uma falha, o Zookeeper elege um substituto e recupera a operação.

Casos de uso

O Kafka se popularizou, principalmente por seu uso como ferramenta de mensagens, mas sua versatilidade vai além, podendo ser utilizado em diversos cenários, como nos exemplos abaixo.

Mensagens

Forma assíncrona de comunicação que desvincula as partes que se comunicam. Nesse modelo, uma parte envia os dados como uma mensagem para o Kafka, para que outro aplicativo os consuma posteriormente.

Acompanhamento de atividades

Permite que você armazene e processe dados de rastreamento da interação de um usuário com um site, como visualizações de página, cliques, entrada de dados, etc.; esse tipo de atividade costuma gerar um grande volume de dados.

Métricas

Envolve a agregação de dados e estatísticas de várias fontes para gerar um relatório centralizado.

Agregação de registros

Agrega e armazena centralmente arquivos de log originados de outros sistemas.

Processamento de fluxo

O processamento de pipelines de dados consiste em vários estágios, em que os dados brutos são consumidos de tópicos e agregados, enriquecidos ou transformados em outros tópicos.

Para oferecer suporte a esses recursos, a plataforma fornece essencialmente três APIs:

- API de fluxos: atua como um processador de fluxo que consome dados de um tópico, os transforma e os grava em outro.

- API de Conectores: Permite conectar tópicos a sistemas existentes, como bancos de dados relacionais.

- APIs de produtor e consumidor: permite que aplicativos publiquem e consumam dados Kafka.

Prós

Replicado, particionado e ordenado

As mensagens no Kafka são replicadas em partições nos nós do cluster na ordem em que chegam para garantir a segurança e a velocidade de entrega.

Transformação de dados

Com o Apache Kafka, é até possível transformar o processamento em lote em tempo real usando a API de fluxos ETL em lote.

Acesso sequencial ao disco

O Apache Kafka persiste a mensagem no disco e não na memória, pois deve ser mais rápido. Na verdade, o acesso à memória é mais rápido na maioria das situações, especialmente quando se considera acessar dados que estão em locais aleatórios na memória. No entanto, o Kafka faz o acesso sequencial e, neste caso, o disco é mais eficiente.

Apache Spark

O Apache Spark é um mecanismo de computação de big data e um conjunto de bibliotecas para processar dados paralelos em clusters. O Spark é uma evolução do Hadoop e do paradigma de programação Map-Reduce. Pode ser 100 vezes mais rápido graças ao uso eficiente da memória que não mantém os dados nos discos durante o processamento.

O Spark está organizado em três níveis:

- APIs de baixo nível: este nível contém a funcionalidade básica para executar trabalhos e outras funcionalidades exigidas pelos outros componentes. Outras funções importantes dessa camada são o gerenciamento de segurança, rede, agendamento e acesso lógico aos sistemas de arquivos HDFS, GlusterFS, Amazon S3 e outros.

- APIs Estruturadas: O nível de API Estruturada trata da manipulação de dados por meio de DataSets ou DataFrames, que podem ser lidos em formatos como Hive, Parquet, JSON e outros. Usando SparkSQL (API que nos permite escrever consultas em SQL), podemos manipular os dados da maneira que quisermos.

- Alto nível: no nível mais alto, temos o ecossistema Spark com várias bibliotecas, incluindo Spark Streaming, Spark MLlib e Spark GraphX. Eles são responsáveis por cuidar da ingestão de streaming e dos processos ao redor, como recuperação de falhas, criar e validar modelos clássicos de aprendizado de máquina e lidar com gráficos e algoritmos.

Funcionamento da faísca

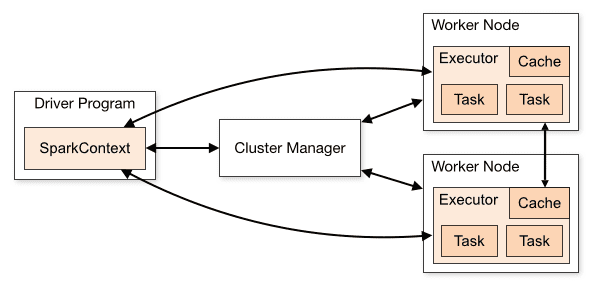

A arquitetura de um aplicativo Spark consiste em três partes principais:

Programa Driver: É responsável por orquestrar a execução do processamento de dados.

Cluster Manager: É o componente responsável por gerenciar as diferentes máquinas de um cluster. Necessário apenas se o Spark for executado distribuído.

Nodos Trabalhadores: São as máquinas que executam as tarefas de um programa. Se o Spark for executado localmente em sua máquina, ele desempenhará um programa de driver e uma função Workes. Essa maneira de executar o Spark é chamada de Standalone.

Visão geral do cluster

Visão geral do cluster

O código Spark pode ser escrito em várias linguagens diferentes. O console Spark, chamado Spark Shell, é interativo para aprender e explorar dados.

O chamado aplicativo Spark é composto por um ou mais Jobs, possibilitando o suporte ao processamento de dados em larga escala.

Quando falamos de execução, o Spark possui dois modos:

- Cliente: O driver é executado diretamente no cliente, que não passa pelo Resource Manager.

- Cluster: Driver rodando no Application Master através do Resource Manager (No modo Cluster, se o cliente se desconectar, o aplicativo continuará rodando).

É necessário usar o Spark corretamente para que os serviços vinculados, como o Resource Manager, possam identificar a necessidade de cada execução, proporcionando o melhor desempenho. Portanto, cabe ao desenvolvedor saber a melhor forma de executar seus jobs do Spark, estruturando a chamada realizada, e para isso, você pode estruturar e configurar os executores do Spark da forma que desejar.

Os trabalhos do Spark usam principalmente memória, por isso é comum ajustar os valores de configuração do Spark para executores de nós de trabalho. Dependendo da carga de trabalho do Spark, é possível determinar que uma determinada configuração não padrão do Spark fornece execuções mais otimizadas. Para isso, podem ser realizados testes de comparação entre as várias opções de configuração disponíveis e a própria configuração padrão do Spark.

Casos de uso

O Apache Spark ajuda no processamento de grandes quantidades de dados, sejam em tempo real ou arquivados, estruturados ou não estruturados. A seguir estão alguns de seus casos de uso populares.

Enriquecimento de dados

Muitas vezes, as empresas usam uma combinação de dados históricos de clientes com dados comportamentais em tempo real. O Spark pode ajudar a construir um pipeline ETL contínuo para converter dados de eventos não estruturados em dados estruturados.

Detecção de evento de gatilho

O Spark Streaming permite detecção e resposta rápidas a alguns comportamentos raros ou suspeitos que podem indicar um possível problema ou fraude.

Análise de dados de sessão complexa

Usando o Spark Streaming, eventos relacionados à sessão do usuário, como suas atividades após o login no aplicativo, podem ser agrupados e analisados. Essas informações também podem ser usadas continuamente para atualizar modelos de aprendizado de máquina.

Prós

Processamento iterativo

Se a tarefa for processar dados repetidamente, os conjuntos de dados distribuídos (RDDs) resilientes do Spark permitem várias operações de mapa na memória sem precisar gravar resultados provisórios em disco.

Processamento gráfico

O modelo computacional do Spark com API GraphX é excelente para cálculos iterativos típicos de processamento gráfico.

Aprendizado de máquina

O Spark possui MLlib — uma biblioteca de aprendizado de máquina integrada que possui algoritmos prontos que também são executados na memória.

Kafka vs Spark

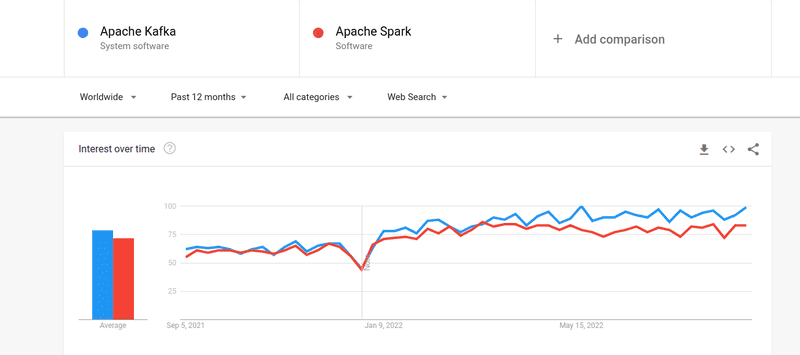

Embora o interesse das pessoas em Kafka e Spark tenha sido quase semelhante, existem algumas diferenças importantes entre os dois; vamos dar uma olhada.

#1. Processamento de dados

Kafka é uma ferramenta de streaming e armazenamento de dados em tempo real responsável pela transferência de dados entre aplicativos, mas não é suficiente para construir uma solução completa. Portanto, outras ferramentas são necessárias para tarefas que o Kafka não faz, como o Spark. O Spark, por outro lado, é uma plataforma de processamento de dados em lote que extrai dados de tópicos Kafka e os transforma em esquemas combinados.

#2. Gerenciamento de memória

O Spark usa Robust Distributed Datasets (RDD) para gerenciamento de memória. Em vez de tentar processar grandes conjuntos de dados, ele os distribui por vários nós em um cluster. Por outro lado, o Kafka usa acesso sequencial semelhante ao HDFS e armazena dados em uma memória buffer.

#3. Transformação ETL

Tanto o Spark quanto o Kafka suportam o processo de transformação ETL, que copia registros de um banco de dados para outro, geralmente de uma base transacional (OLTP) para uma base analítica (OLAP). No entanto, ao contrário do Spark, que vem com uma capacidade integrada para o processo ETL, o Kafka conta com a API do Streams para apoiá-lo.

#4. Persistência de dados

O uso de RRD do Spark permite que você armazene os dados em vários locais para uso posterior, enquanto no Kafka, você precisa definir objetos de conjunto de dados na configuração para persistir os dados.

#5. Dificuldade

Spark é uma solução completa e fácil de aprender devido ao seu suporte para várias linguagens de programação de alto nível. O Kafka depende de várias APIs e módulos de terceiros diferentes, o que pode dificultar o trabalho.

#6. Recuperação

Tanto o Spark quanto o Kafka fornecem opções de recuperação. O Spark usa o RRD, o que permite salvar dados continuamente e, se houver uma falha no cluster, ele pode ser recuperado.

O Kafka replica continuamente os dados dentro do cluster e a replicação entre os brokers, o que permite que você passe para os diferentes brokers se houver uma falha.

Semelhanças entre Spark e Kafka

Apache SparkApache KafkaOpenSourceOpenSourceBuild Data Streaming ApplicationBuild Data Streaming ApplicationSuporta Stateful ProcessingSuporta Stateful ProcessingSuporta SQLSuporta SQLSimilaridades entre Spark e Kafka

Palavras finais

Kafka e Spark são ferramentas de código aberto escritas em Scala e Java, que permitem criar aplicativos de streaming de dados em tempo real. Eles têm várias coisas em comum, incluindo processamento com estado, suporte para SQL e ETL. Kafka e Spark também podem ser usados como ferramentas complementares para ajudar a resolver o problema da complexidade da transferência de dados entre aplicativos.