Explorando os Golpes Deepfake Mais Prevalentes

Iniciemos com uma amostra de um discurso “especial” do “POTUS” Joe Biden:

A amostra sugere um golpe deepfake (de voz) convincente. Na realidade, foi gerada por uma ferramenta gratuita de clonagem de voz com IA. Dediquei pouco mais de cinco minutos, usando o ChatGPT para compor o texto e depois o transformei no discurso de Biden.

Entretanto, os golpes deepfake são consideravelmente mais complexos. É necessário apenas algumas fotos, vídeos ou gravações de áudio de alta qualidade do indivíduo (vítima) e uma placa gráfica potente para começar a criar essas falsificações.

O objetivo aqui não é explicar como produzir vídeos deepfake, nem como identificá-los.

O artigo visa apresentar uma breve visão geral sobre deepfakes e mencionar alguns dos golpes que exigem atenção especial.

O que são deepfakes?

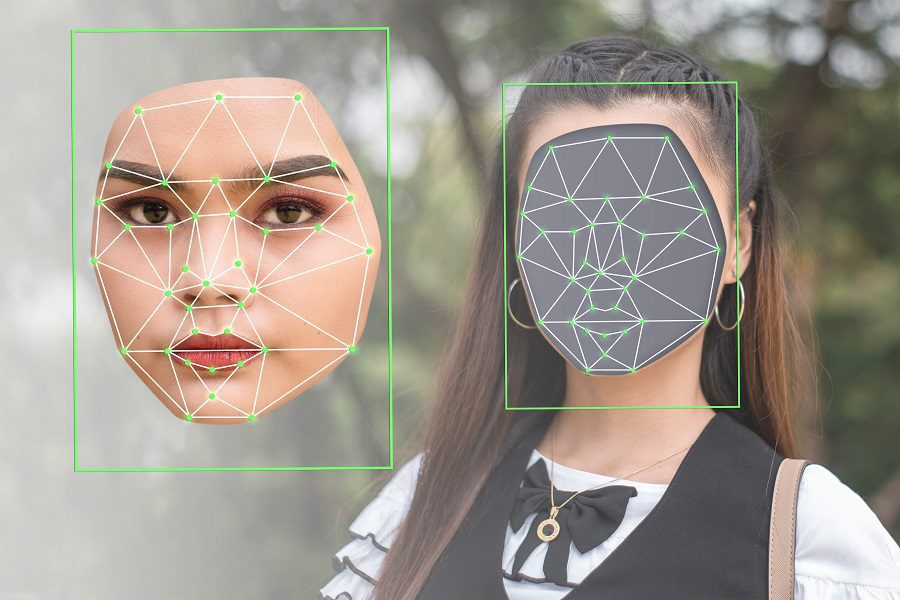

O termo “deepfake” é uma junção de “deep” (de aprendizado profundo, a técnica usada em sua criação) e “fake” (indicando a natureza não autêntica do produto final).

Em resumo, algoritmos de aprendizado profundo são utilizados para gerar imagens, áudios ou vídeos que parecem autênticos, a partir de materiais originais de alta qualidade.

Este é um exemplo clássico de deepfake, e demonstra um nível de eficácia significativo. No entanto, esse exemplo já tem cinco anos, e a tecnologia está evoluindo rapidamente.

O uso de deepfakes nem sempre é voltado para diversão ou demonstração de capacidades de IA. Um caso sério é o vídeo onde “Volodymyr Zelensky” é supostamente instruído por suas próprias forças a se render na atual Guerra Rússia-Ucrânia.

Infelizmente, esta não é uma ocorrência isolada. De acordo com o Relatório Regula Forensics 2023, 37% das organizações em todo o mundo foram vítimas de fraudes de voz deepfake, 29% foram afetadas por golpes de vídeo sintético, e 46% enfrentaram tentativas de roubo de identidade.

Assim, é evidente que deepfakes vão além do entretenimento, sendo amplamente empregados para disseminar desinformação e abusados de outras formas, causando danos e sofrimento às vítimas.

Além disso, combater deepfakes não é fácil, pois são um subproduto dos avanços em IA e a disponibilidade dessas ferramentas para o público.

Portanto, a principal defesa disponível é a conscientização.

Vamos explorar essas questões e analisar os principais tipos de golpes deepfake.

Tipos de Golpes Deepfake

Com base no conteúdo e no alvo, os golpes deepfake podem ser categorizados em várias modalidades, incluindo:

- Personificação em vídeo

- Entrevistas simuladas

- Notícias fabricadas

- Fraude vocal

- Armadilhas amorosas (honeytraps)

- Falso suporte ao cliente

- Testemunhos falsos

As próximas seções detalharão essas categorias e algumas de suas variações.

Personificação em Vídeo

Este é um tipo comum de golpe deepfake, no qual um vídeo falso é criado para simular uma figura pública. As vítimas mais frequentes são presidentes de países (como o deepfake de Obama), celebridades e CEOs de empresas conhecidas.

A disponibilidade pública de fotos e discursos torna essas figuras alvos fáceis, já que as ferramentas de criação de deepfake utilizam essa informação para reproduzir emoções, ângulos faciais, condições de iluminação e fundos de forma realista.

A motivação por trás dessas personificações pode ser humor, chantagem, manipulação política, difamação ou outras.

Em raras ocasiões, podem ser vistos vídeos falsos de familiares pedindo dinheiro ou acesso a bens valiosos.

Entrevistas Falsas

As entrevistas falsas, facilitadas pela tecnologia deepfake, visam empregos remotos. Esses golpes empregam deepfakes em tempo real em plataformas de videoconferência como o Zoom.

Além de contratar um candidato inadequado, a empresa corre o risco de expor informações confidenciais a um fraudador. Dependendo das atividades da empresa, isso pode comprometer tanto seus próprios recursos quanto os interesses nacionais.

Um objetivo mais direto das entrevistas deepfake é obter pagamentos em moedas de alto valor.

Por outro lado, os golpistas podem cobrar taxas de entrevista de candidatos inocentes com a promessa de acesso a “líderes da indústria” para um emprego dos sonhos.

Notícias Fabricadas

As notícias falsas são um tipo frequente de golpe deepfake. Essas campanhas de desinformação online representam perigos significativos, especialmente em situações tensas como tumultos ou guerras.

Além disso, figuras públicas podem ser difamadas quando suas réplicas deepfake fazem declarações que nunca fizeram.

Plataformas de mídia social e streaming como o YouTube contribuem para a propagação rápida de notícias falsas, criando um ambiente onde os usuários comuns ficam incertos sobre a autenticidade do conteúdo que consomem.

Fraude Vocal

A voz sintética, semelhante a vídeos e imagens deepfake, é uma ferramenta adicional na lista de fraudes baseadas em tecnologia.

Num caso notório, Jennifer DeStefano, do Arizona, ouviu sua filha de 15 anos chorando ao telefone enquanto uma voz masculina exigia um resgate de 1 milhão de dólares. A mãe acreditou que sua filha estava em perigo. Antes de realizar o pagamento, uma amiga ligou para o marido de Jennifer, confirmando que a filha estava bem.

DeStefano descreveu sua provação, enfatizando que acreditou na voz devido ao timbre e à entonação, que imitavam perfeitamente a maneira como sua filha falava.

Isso é clonagem de voz, feita com amostras de áudio do alvo.

Armadilhas Amorosas

Tradicionalmente, uma armadilha amorosa (honeytrap) envolve persuadir alguém a um relacionamento para obter informações confidenciais. As vítimas mais comuns são indivíduos de alto perfil, como militares, funcionários do governo e políticos.

Com a tecnologia deepfake, essas armadilhas se tornaram majoritariamente online e podem ser operadas por qualquer pessoa em grande escala. A vítima pode receber solicitações de relacionamento de parceiros atraentes nas mídias sociais, que rapidamente se tornam íntimos com o objetivo de extorsão financeira ou informativa.

Esses golpes deepfake são geralmente operações elaboradas, seguindo um curso antes de armar a armadilha final.

Suporte ao Cliente Falso

Golpes de suporte técnico são comuns. É possível que você já tenha ouvido falar de golpes em que um indivíduo se passa por funcionário da “Microsoft” e pede dinheiro para resolver problemas “graves” do seu computador.

Antes do deepfake, sotaques ou padrões de fala incomuns revelavam essas tentativas maliciosas. Agora, os golpistas contam com o auxílio da IA, que pode facilmente enganar usuários desavisados, fazendo-os acreditar que estão falando com um representante legítimo da empresa.

Testemunhos Falsos

Muitas pessoas leem avaliações de clientes antes de comprar um produto. Da mesma forma, os testemunhos em vídeo são uma prática comum para auxiliar na decisão de compra.

Este tipo de golpe deepfake faz com que várias pessoas atestem um produto de má qualidade, influenciando as decisões de compra e desperdiçando tempo e dinheiro dos clientes.

Há Muitos Mais!

Além de texto, o que mais você encontra na internet?

Videos, imagens e áudios. Todos podem ser manipulados com esta tecnologia de IA, tornando a Internet um terreno fértil para fraudes em um futuro próximo. Além disso, criar deepfakes está se tornando mais fácil, dificultando que o usuário médio se mantenha “corretamente” informado.

Nessas circunstâncias, em que o uso indevido da tecnologia é difícil de impedir, devemos pelo menos tentar nos manter informados.

P.S: Para diversão, existem aplicativos deepfake que permitem criar memes engraçados e ganhar as redes sociais.