Seu explicador completo sobre Deepfakes e para torná-los facilmente com o Faceswap.

A Inteligência Artificial não é mais tão ‘artificial’. Esses tempos o colocaram perigosamente perto de nós, humanos.

Ele pode sugerir, escrever, criar arte e agora parece e fala como os vivos.

Este é um dos desenvolvimentos mais recentes neste domínio que devemos aproveitar. No entanto, este também é um dos quais devemos ter cuidado.

últimas postagens

O que são deepfakes?

A palavra Deepfake é cunhada pela combinação de deep learning e fake. Em termos simples, você também pode presumir que se trata de uma mídia habilmente manipulada ou profundamente falsificada.

De acordo com a Wikipedia, isso também é conhecido como mídia sintética, na qual uma imagem, áudio ou vídeo existente é modificado para representar outra pessoa inteiramente.

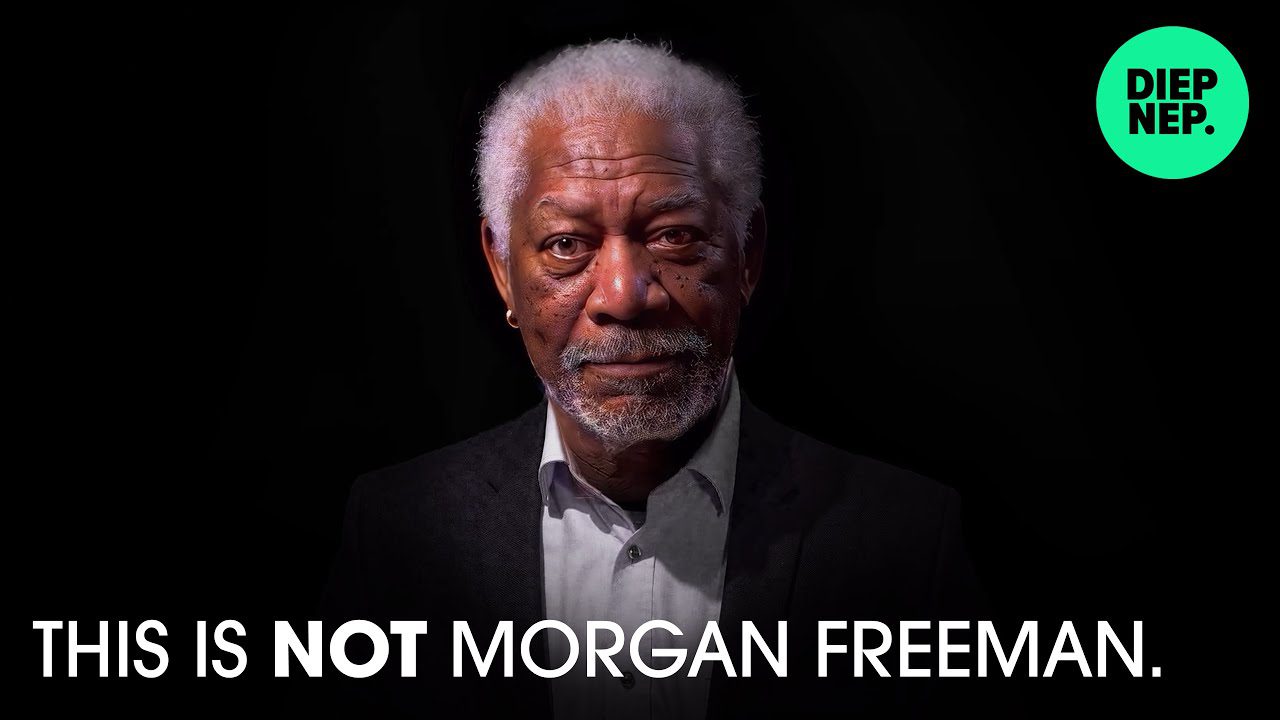

Normalmente, os deepfakes fazem com que personalidades renomadas pareçam dizer algo que de outra forma não diriam.

Com base na habilidade de seu criador, pode ser extremamente difícil dizer se é real ou falso.

Como funcionam os deepfakes?

Simplificando, uma parte do vídeo original (digamos, um rosto) é substituída por uma falsificação de aparência semelhante. Nesse caso, também pode ser chamado de facewap, como neste vídeo de ‘Obama’.

No entanto, não se limita apenas ao vídeo, e também temos imagens e áudio deepfakes (e quem sabe, avatares VR deepfake em um futuro próximo).

Fonte: Disney

A metodologia de trabalho por trás desses truques depende principalmente do aplicativo e do algoritmo subjacente.

De acordo com este trabalho de pesquisa da Disney, existem várias técnicas, incluindo codificadores-decodificadores, Generative Adversarial Networks (GANs), deepfakes baseados em geometria, etc.

No entanto, as seções a seguir são afetadas principalmente pela forma como funciona com o Facewap. Este é um software Deepfake gratuito e de código aberto que permite vários algoritmos para obter o resultado esperado.

Existem três processos principais para gerar deepfakes: extração, treinamento e conversão.

#1. Extração

Trata-se de detectar e espremer a área de interesse de amostras de mídia, o original e aquele para a troca.

Com base nos recursos de hardware, pode haver muitos algoritmos para optar por uma detecção eficiente.

Por exemplo, o Faceswap tem algumas opções diferentes para extração, alinhamento e mascaramento com base na eficiência da CPU ou GPU.

A extração simplesmente identifica o rosto no vídeo geral. O alinhamento aponta características cruciais de qualquer rosto (olhos, nariz, queixo, etc.). E, por último, o mascaramento bloqueia outros elementos da imagem, exceto a área de interesse.

O tempo total gasto para a saída é importante na seleção de qualquer opção, pois a escolha de algoritmos com uso intensivo de recursos em hardware medíocre pode resultar em falha ou em um tempo substancialmente longo para renderizar resultados aceitáveis.

Além do hardware, a escolha também depende de parâmetros como se o vídeo de entrada sofre de obstruções faciais, como movimentos das mãos ou óculos.

Um elemento necessário, no final, é a limpeza (explicada posteriormente) da saída, pois as extrações terão alguns falsos positivos.

Por fim, a extração é repetida para o vídeo original e o falso (usado para troca).

#2. Treinamento

Este é o coração da criação de deepfakes.

O treinamento é sobre a rede neural, que consiste no codificador e no decodificador. Aqui, os algoritmos são alimentados com os dados extraídos para criar um modelo para a conversão posterior.

O codificador converte a entrada em uma representação vetorial para treinar o algoritmo para recriar as faces a partir dos vetores, conforme feito pelo decodificador.

Posteriormente, a rede neural avalia suas iterações e as compara com a original atribuindo uma pontuação de perda. Esse valor de perda cai com o tempo conforme o algoritmo continua iterando e você para quando as visualizações são aceitáveis.

O treinamento é um processo demorado e as saídas geralmente melhoram com base nas iterações realizadas e na qualidade dos dados de entrada.

Por exemplo, o Faceawap sugere um mínimo de 500 imagens cada, originais e para troca. Além disso, as imagens devem diferir significativamente entre si, abrangendo todos os ângulos possíveis em iluminação única para a melhor recreação.

Devido à duração do treinamento, alguns aplicativos (como o Faceswap) permitem interromper o treinamento no meio do caminho ou continuar mais tarde.

Notavelmente, o fotorrealismo da saída também depende da eficiência do algoritmo e da entrada. E um é novamente limitado pelas capacidades de hardware.

#3. Conversão

Este é o último capítulo da criação do deepfake. Os algoritmos de conversão precisam do vídeo de origem, do modelo treinado e do arquivo de alinhamento de origem.

Posteriormente, pode-se alterar algumas opções relacionadas à correção de cores, tipo de máscara, formato de saída desejado, etc.

Depois de configurar essas poucas opções, é só aguardar o render final.

Como mencionado, o Faceswap funciona com muitos algoritmos, e pode-se jogar entre eles para obter um facewap tolerável.

Isso é tudo?

Não!

Isso foi apenas troca de rosto, um subconjunto da tecnologia deepfake. A troca de rosto, como o significado literal, apenas substitui uma parte do rosto para dar uma vaga ideia sobre o que os deepfakes podem fazer.

Para uma troca confiável, você também pode precisar imitar o áudio (mais conhecido como clonagem de voz) e todo o físico, incluindo tudo o que cabe no quadro, assim:

Então, o que está em jogo aqui?

O que pode ter acontecido é que o próprio autor do deepfake gravou o vídeo (como indicado nos últimos segundos), sincronizou o diálogo com a voz sintética de Morgan Freeman e recolocou a cabeça.

Conclusivamente, não se trata apenas de facewap, mas de todo o quadro, incluindo o áudio.

Você pode encontrar toneladas de deepfakes no YouTube a ponto de se tornar assustador sobre o que confiar. E tudo o que é preciso é um computador poderoso com uma placa gráfica eficiente para começar.

No entanto, a perfeição é difícil de alcançar e é especialmente verdade com os deepfakes.

Para um deepfake convincente que pode enganar ou impressionar o público, é preciso habilidade e alguns dias a semanas de processamento para um ou dois minutos de vídeo.

Curiosamente, é assim que esses algoritmos são capazes a partir de agora. Mas o que o futuro reserva, incluindo a eficácia desses aplicativos em hardware de baixo custo, é algo que deixou governos inteiros nervosos.

No entanto, não vamos mergulhar em suas repercussões futuras. Em vez disso, vamos verificar como fazer você mesmo para se divertir um pouco.

Criando vídeos deepfake (básicos)

Você pode verificar muitos aplicativos nesta lista de aplicativos deepfake para criar memes.

Um deles é o Faceswap, que usaremos.

Há algumas coisas que garantiremos antes de prosseguir. Primeiro, devemos ter um vídeo de boa qualidade do alvo retratando emoções variadas. Em seguida, precisaremos de um vídeo de origem para trocar para o destino.

Além disso, feche todos os aplicativos intensivos de placa gráfica, como navegadores ou jogos, antes de prosseguir com o Faceswap. Isso é especialmente verdadeiro se você tiver menos de 2 GB de VRAM (RAM de vídeo).

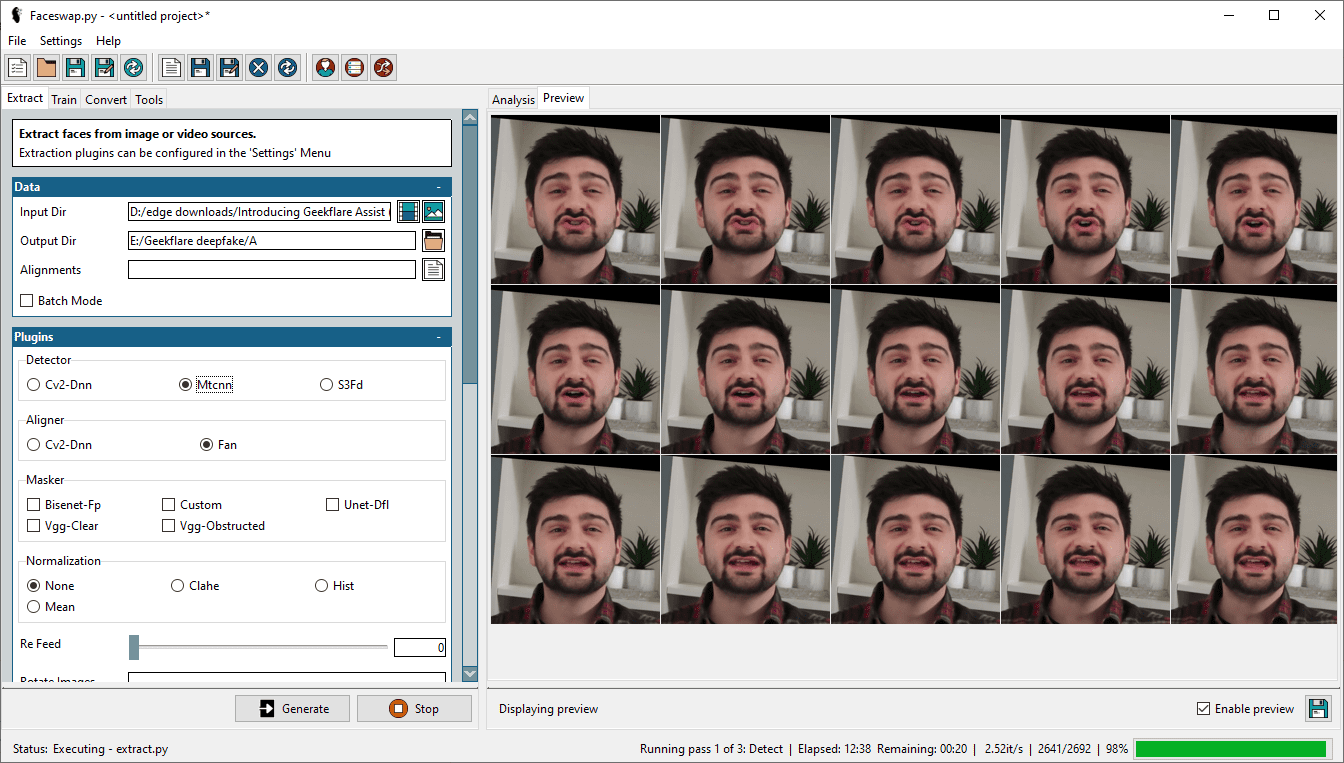

Passo 1: Extraindo Faces

A primeira etapa desse processo é extrair os rostos do vídeo. Para isso, temos que selecionar o vídeo de destino no Input Dir e listar um Output Dir para as extrações.

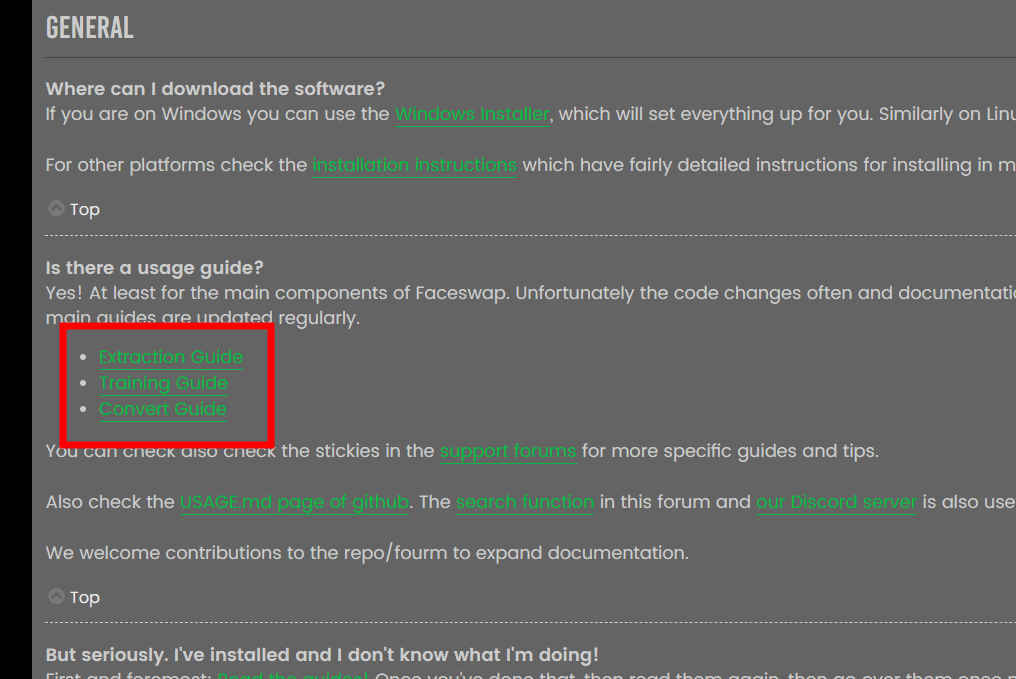

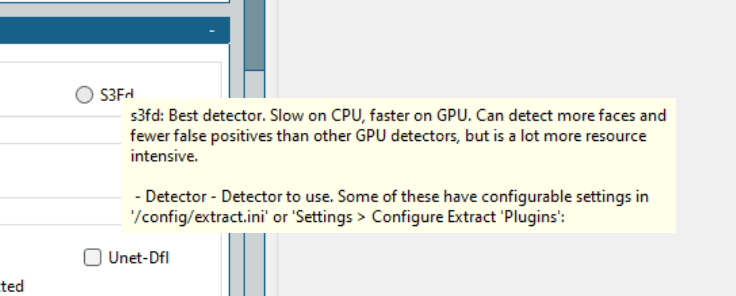

Além disso, existem algumas opções, incluindo detector, alinhador, mascarador, etc.; as explicações para cada um estão nas perguntas frequentes do Faceawap e seria um desperdício repetir as informações aqui.

Fonte: FAQ do Faceswap

Fonte: FAQ do Faceswap

Geralmente é bom revisar a documentação para uma melhor compreensão e uma saída decente. No entanto, existem textos úteis no Faceswap que você pode encontrar passando o mouse sobre a opção específica.

Simplificando, não existe uma maneira universal, e deve-se começar com os melhores algoritmos e trabalhar com sucesso para criar um deepfake convincente.

Para contextualizar, usei Mtcnn (detector), Fan (alinhador) e Bisenet-Fp (mascarador), mantendo todas as outras opções como estão.

Originalmente, tentei com S3Fd (melhor detector) e algumas outras máscaras combinadas. No entanto, minha Nvidia GeForce GTX 750Ti de 2 Gb não suportou o peso e o processo falhou repetidamente.

Por fim, reduzi minhas expectativas e as configurações para ver isso acontecer.

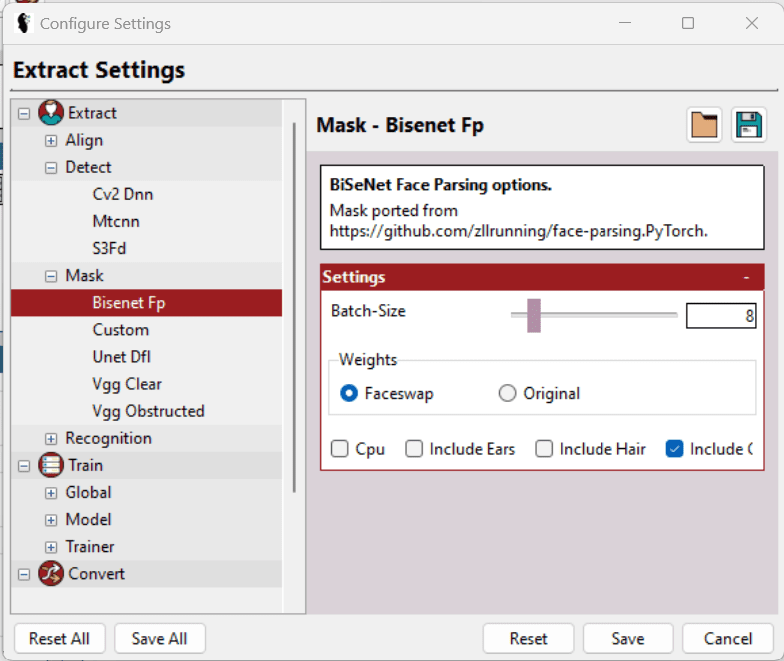

Além de selecionar o detector apropriado, mascaradores, etc., existem mais algumas opções em Configurações > Definir configurações que ajudam a ajustar ainda mais as configurações individuais para ajudar o hardware.

Simplificando, selecione o tamanho de lote, tamanho de entrada e tamanho de saída mais baixos possíveis e marque LowMem, etc. Essas opções não estão disponíveis universalmente e são baseadas em uma seção específica. Além disso, os textos de ajuda auxiliam ainda mais na seleção das melhores opções.

Embora essa ferramenta faça um excelente trabalho de extração de faces, os quadros de saída podem ter muito mais do que o necessário para treinar (discutido posteriormente) o modelo. Por exemplo, ele terá todos os rostos (se o vídeo tiver mais de um) e algumas detecções impróprias não terão o rosto de destino.

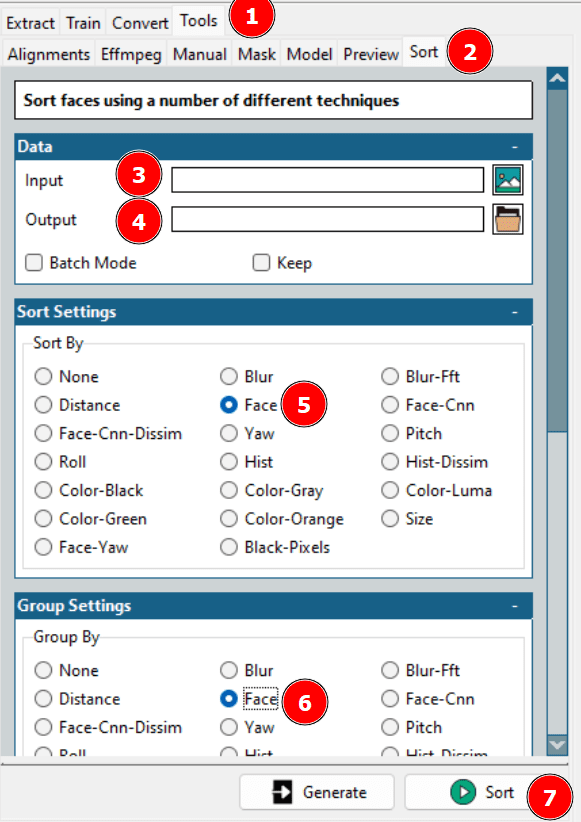

Isso leva à limpeza dos conjuntos de dados. Qualquer um pode verificar a pasta de saída e excluir a si mesmo ou usar a classificação Faceswap para obter ajuda.

Usando a ferramenta mencionada acima, você organizará diferentes rostos em sequência, onde poderá agrupar os necessários em uma única pasta e excluir o restante.

Como lembrete, você também deseja repetir a extração do vídeo de origem.

Etapa 2: treinando o modelo

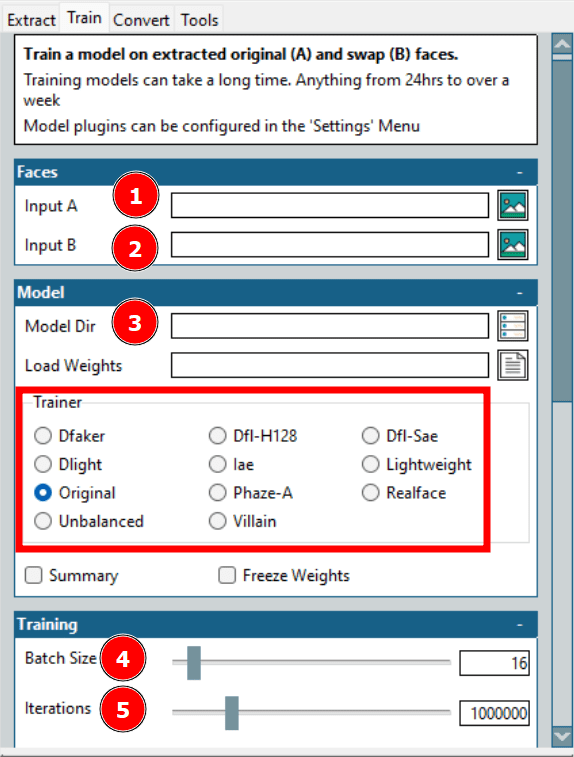

Este é o processo mais longo na criação de um deepfake. Aqui, a entrada A refere-se à face de destino e a entrada B refere-se à face de origem. Além disso, o Model Dir é onde os arquivos de treinamento serão salvos.

Aqui a opção mais significativa é o Trainer. Existem muitas opções de dimensionamento individuais; no entanto, o que funcionou para o meu hardware são os treinadores Dfl-H128 e Lightweight com as configurações mais baixas.

Em seguida é o tamanho do lote. Um tamanho de lote maior reduz o tempo geral de treinamento, mas consome mais VRAM. As iterações não têm efeito fixo na saída e você deve definir um valor alto o suficiente e interromper o treinamento assim que as visualizações forem aceitáveis.

Existem mais algumas configurações, incluindo a criação de um lapso de tempo com intervalos predefinidos; no entanto, treinei o modelo com o mínimo necessário.

Passo 3: Trocar no Original

Este é o último feito na criação do deepfake.

Isso geralmente não leva muito tempo e você pode jogar com muitas opções para obter a saída desejada rapidamente.

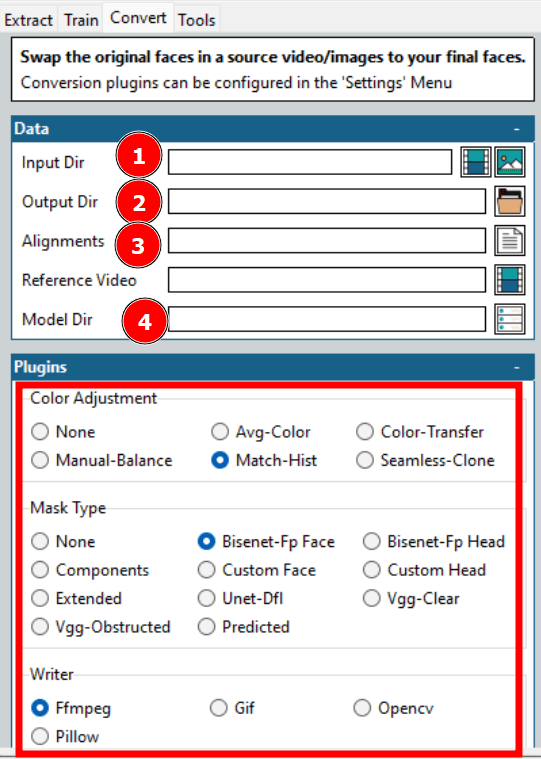

Conforme indicado na imagem acima, essas são algumas opções que você precisa escolher para iniciar a conversão.

A maioria das opções já foram discutidas, como o diretório de entrada e saída, o diretório do modelo, etc. Uma coisa crucial são os alinhamentos que se referem ao arquivo de alinhamento (.fsa) do vídeo de destino. Ele é criado no diretório de entrada durante a extração.

O campo Alinhamentos pode ser deixado em branco se esse arquivo específico não tiver sido movido. Caso contrário, pode-se selecionar o arquivo e passar para outras opções. No entanto, lembre-se de limpar o arquivo de alinhamento se tiver limpado as extrações anteriormente.

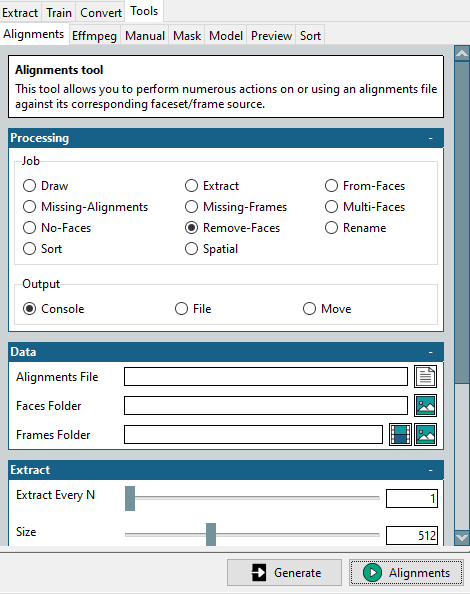

Para isso, essa miniferramenta fica em Ferramentas > Alinhamentos.

Comece selecionando Remove-Faces na seção Job, selecione o arquivo de alinhamento original e a pasta de faces de destino limpas e clique em Alignments no canto inferior direito.

Isso criará um arquivo de alinhamento modificado, correspondendo à pasta de faces otimizadas. Lembre-se de que precisamos disso para o vídeo de destino, para o qual queremos trocar.

Mais algumas configurações incluem o ajuste de cor e o tipo de máscara. O ajuste de cor determina a mistura da máscara e você pode tentar alguns, verificar a visualização e selecionar a opção ideal.

O tipo de máscara é mais importante. Isso, novamente, depende de suas expectativas e do hardware disponível. Normalmente, você também precisa considerar as características do vídeo de entrada. Por exemplo, Vgg-Clear funciona bem com faces frontais sem obstruções, enquanto Vgg-Obstructed também funciona com obstruções, como gestos manuais, óculos, etc.

Em seguida, o Writer apresenta algumas opções com base na saída desejada. Por exemplo, selecione Ffmpeg para uma renderização de vídeo.

No geral, a chave para um deepfake bem-sucedido é visualizar algumas saídas e otimizar de acordo com a disponibilidade de tempo e a potência do hardware.

Aplicações do Deepfake

Existem aplicações boas, ruins e perigosas de deepfakes.

As boas consistem em recriar aulas de história por quem já esteve lá para maior engajamento.

Além disso, estão sendo utilizados por plataformas de aprendizagem online para gerar vídeos a partir de textos.

Mas um dos maiores beneficiados será a indústria cinematográfica. Aqui, será fácil imaginar o verdadeiro protagonista realizando acrobacias, mesmo quando for o dublê arriscando sua vida. Além disso, fazer filmes em vários idiomas será mais fácil do que nunca.

Chegando aos ruins, infelizmente, são muitos. O maior aplicativo de deepfake até hoje, na verdade, 96% (conforme este relatório da Deeptrace), está na indústria pornográfica para trocar rostos de celebridades por atores pornôs.

Além disso, os deepfakes também são armados contra mulheres não-celebridades ‘padrão’. Normalmente, essas vítimas têm fotos ou vídeos de alta qualidade em seus perfis de mídia social que são usados para a criação de deepfakes.

Outra aplicação assustadora é o vishing, também conhecido como phishing por voz. Em um desses casos, o CEO de uma empresa sediada no Reino Unido transferiu US$ 243.000 sob as ordens do ‘CEO’ de sua empresa-mãe alemã, apenas para descobrir mais tarde que era na verdade um telefonema deepfake.

Mas o que é ainda mais perigoso é o deepfake provocar guerras ou pedir rendição. Uma tentativa mais recente viu o presidente ucraniano, Volodymyr Zelenskyy, dizer a suas forças e pessoas para se renderem na guerra em andamento. No entanto, a verdade desta vez foi revelada pelo vídeo abaixo da média.

Conclusivamente, existem muitos aplicativos deepfake e está apenas começando.

Isso nos leva à pergunta de um milhão de dólares…

Deepfakes é legal?

Isso depende principalmente da administração local. Porém, leis bem definidas, incluindo o que é permitido e o que não é, ainda não foram vistas.

Ainda assim, o que é óbvio é que depende de para que você está usando os deepfakes – a intenção. Dificilmente haverá algum dano se você pretende entreter ou educar alguém sem perturbar o alvo de troca.

Por outro lado, aplicativos maliciosos devem ser punidos por lei, independentemente da jurisdição. Outra área cinzenta é a violação de direitos autorais, que precisa ser considerada adequadamente.

Mas, para reiterar, você deve verificar com os órgãos do governo local sobre os aplicativos legais de deepfake.

Fique de olho!

Deepfkaes aproveita a inteligência artificial para fazer qualquer um dizer coisas.

Não confie em nada que você vê na internet é o primeiro conselho que devemos seguir. Há toneladas de desinformação e sua eficácia só aumenta.

E como será mais fácil criá-los, é hora de aprendermos a identificar deepfakes.